基于deepseek本地化对话机器人搭建

随时deepseek春节的爆火出圈,通过deepseek官网使用AI对话能力,出现稍后再试的概率越来越高。deepseek又开源了模型,本着自己动手丰衣足食的想法,尝试通过本地搭建私人订制的AI,后续会考虑搭建本地代码生成机器人来提升工作效率。

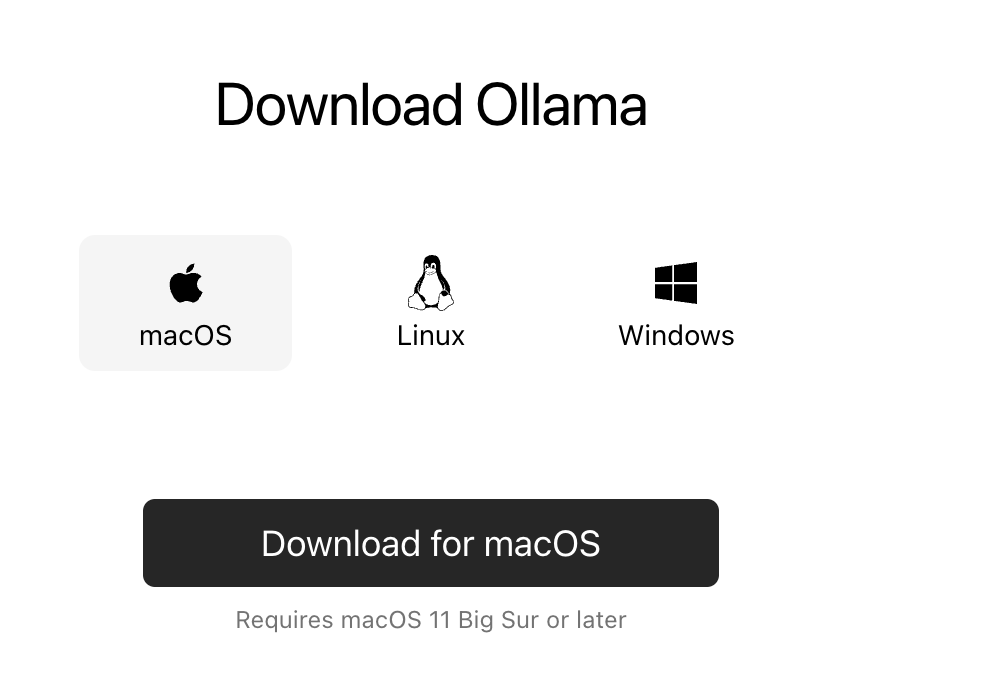

ollama安装

根据搭建环境系统信息下载Ollama 对应版本到本地

下载完成后,根据安装提示进行ollama安装,安装完成后在命令行输入

> ollama -v

ollama version is 0.5.7

输出ollama版本这说明ollama安装成功,通过下列命令拉取和运行相应版本deepseek模型

> ollama run deepseek-r1:7b

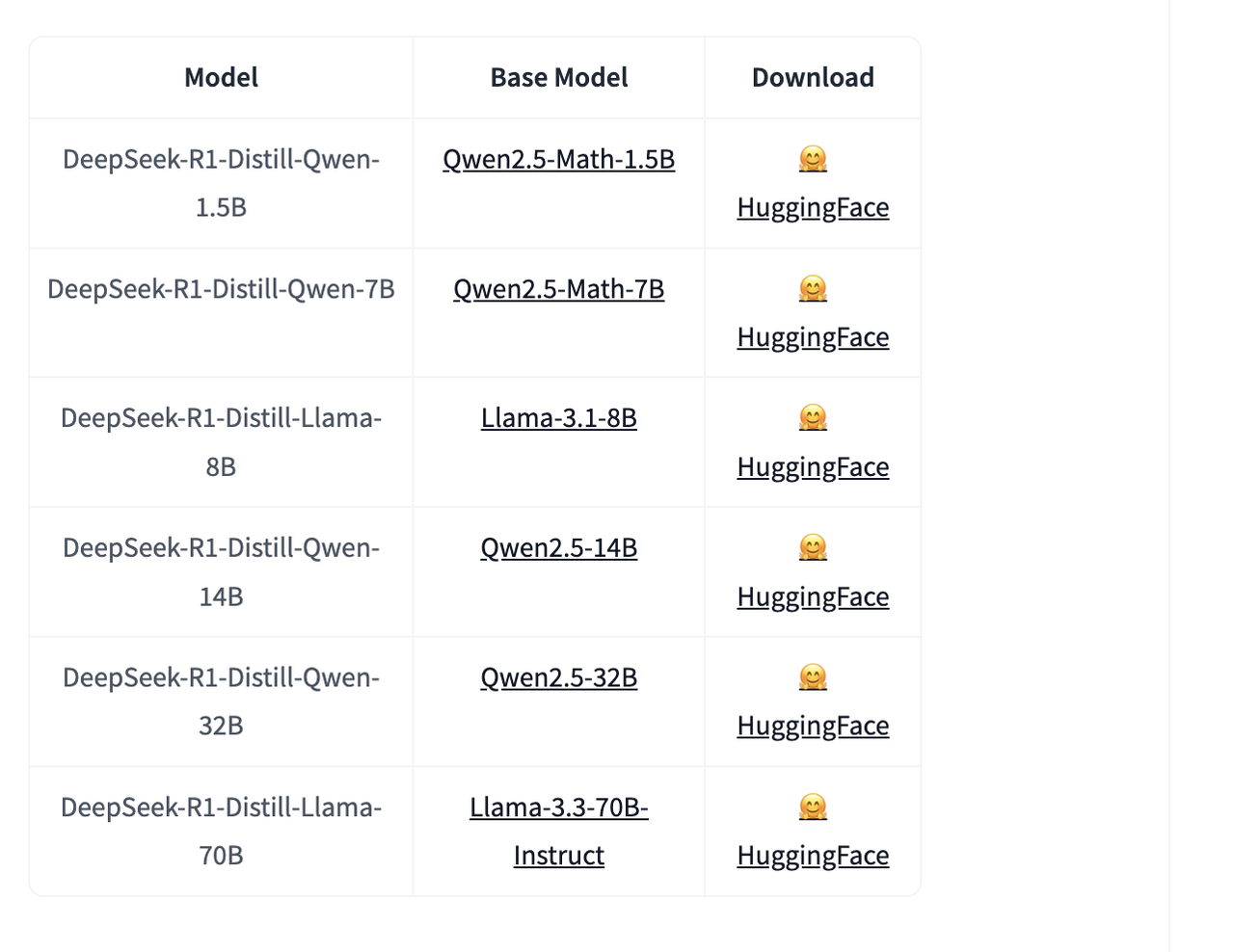

目前Deepseek-r1 提供 如下几种不同参数r1模型

可视化UI对话机器人搭建

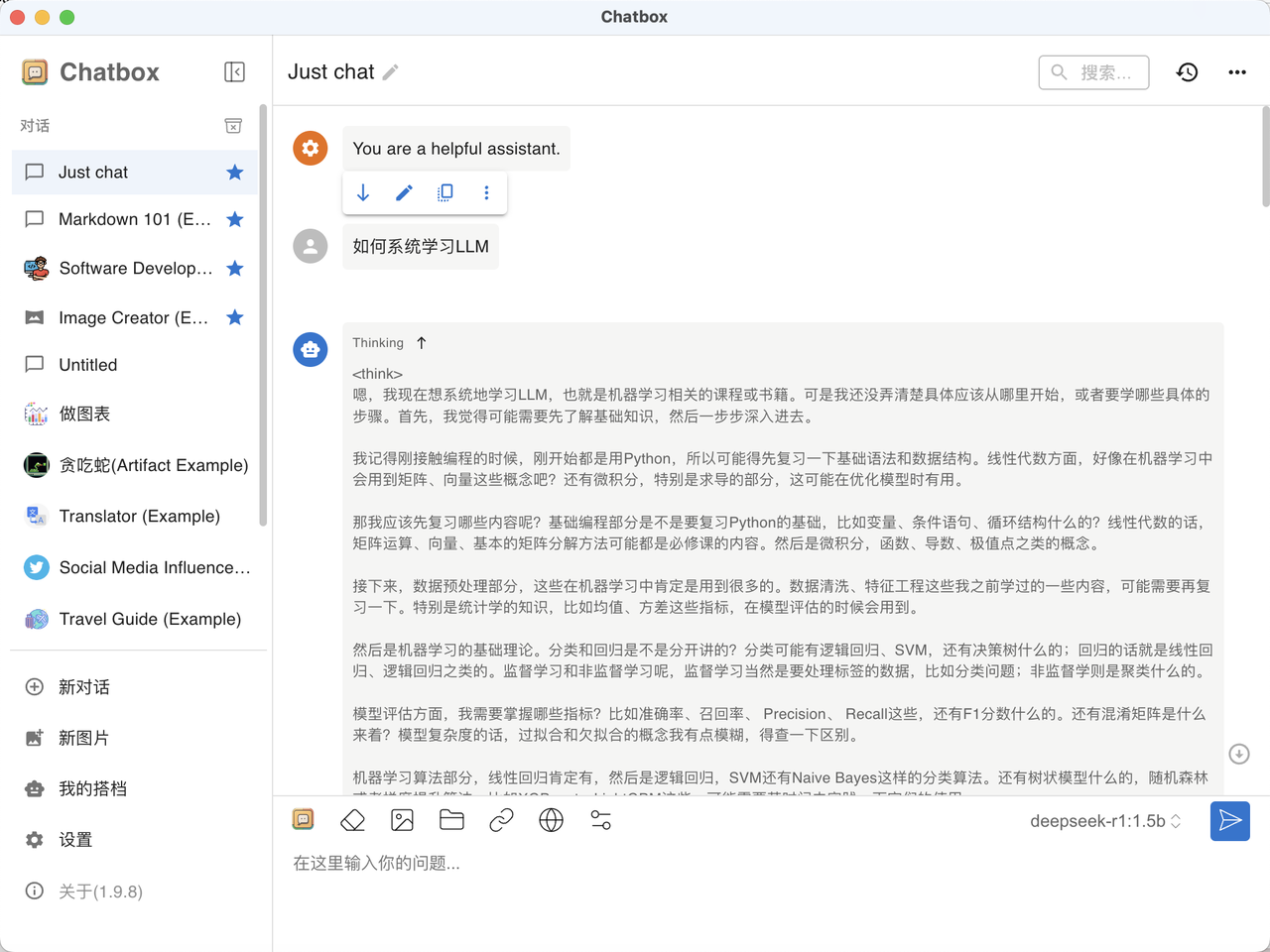

Chatbox搭建可视化本地对话机器人

ChatBox官网下载 ,根据部署模型机器系统信息,选择相应系统版本进行下载

下载完成后根据提示进行安装

在chatBox应用界面点击设置后

“模型”选项卡中,“模型提供方”选择“Ollama API”,“模型”选择 1步骤中通过ollama 拉取的deepseek模型。

- 完成配置后,即可通过ChatBox来体验deepseek模型的对话能力

LM studio搭建可视化本地对话机器人

- LM Studio官网,根据部署模型机器系统信息,选择相应系统版本进行下载

下载完成后根据提示进行安装

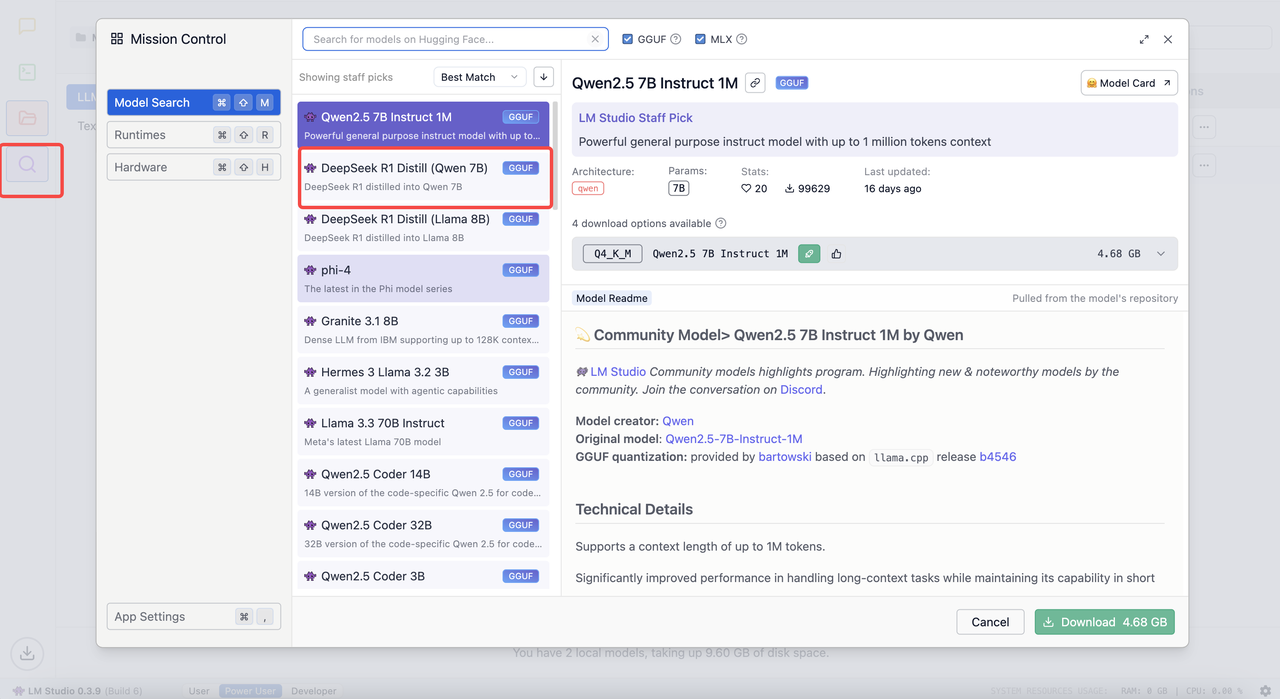

模型下载和配置,通过点击左侧栏的”搜索”按钮,在“model search”选项卡中,选择想要使用的模型进行下载

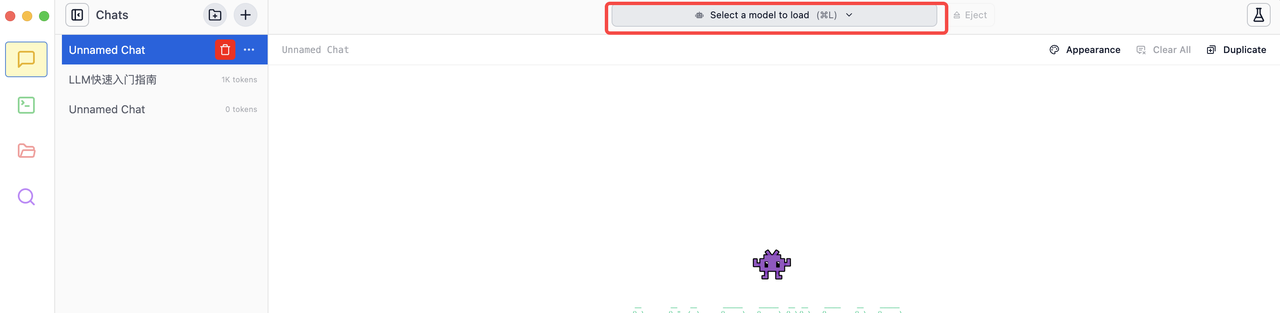

- 模型下载完成后,下聊天页面点击“select a model to load”选择刚刚下载的模型,即可开启deepseek模型对话能力

以上两种方式都可以快速可视化的体验本地deepseek模型对话能力,美中不足两种方式deepseek模型都无法在对话时,获取和总结相关网络搜索信息。

联网搜索及知识库扩展

本地模型联网搜索能力可以通过chrome插件 page assist 进行支持,通过chrome插件商店下载page assist并安装(github:page assist)。

搜索设置

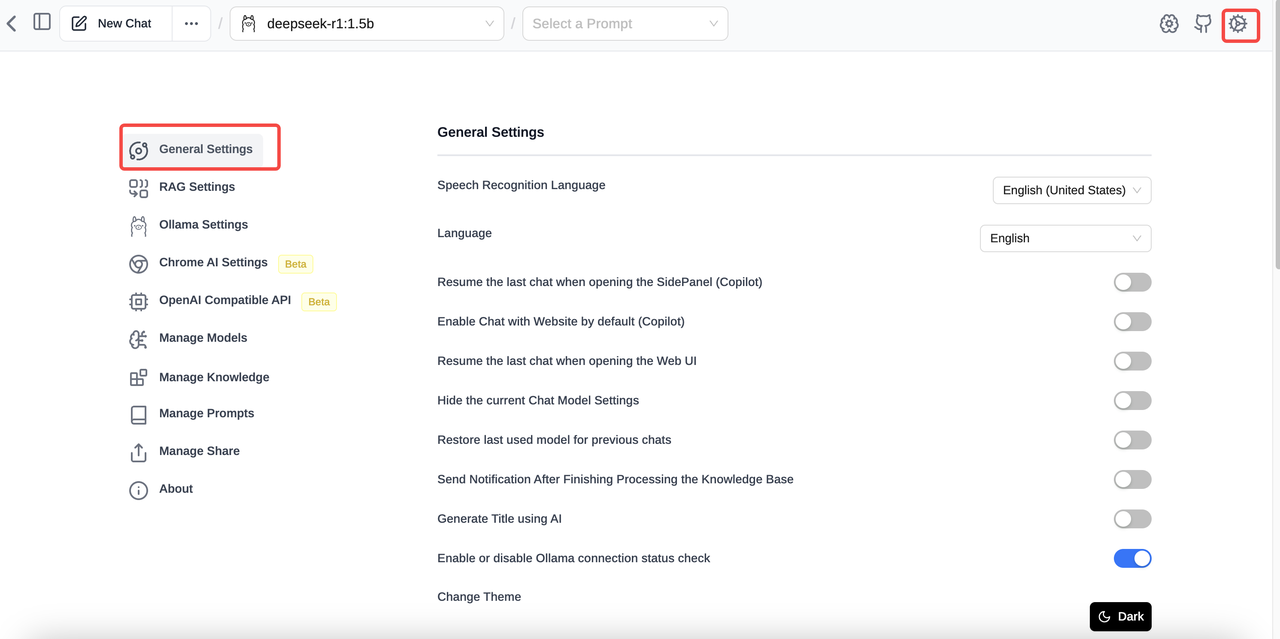

chrome浏览器的插件管理中点击 page assist图标即可唤起 page assist web页面,如下图,点击右上角设置按钮,进入设置页面,选择“General Setting” 进行搜索设置

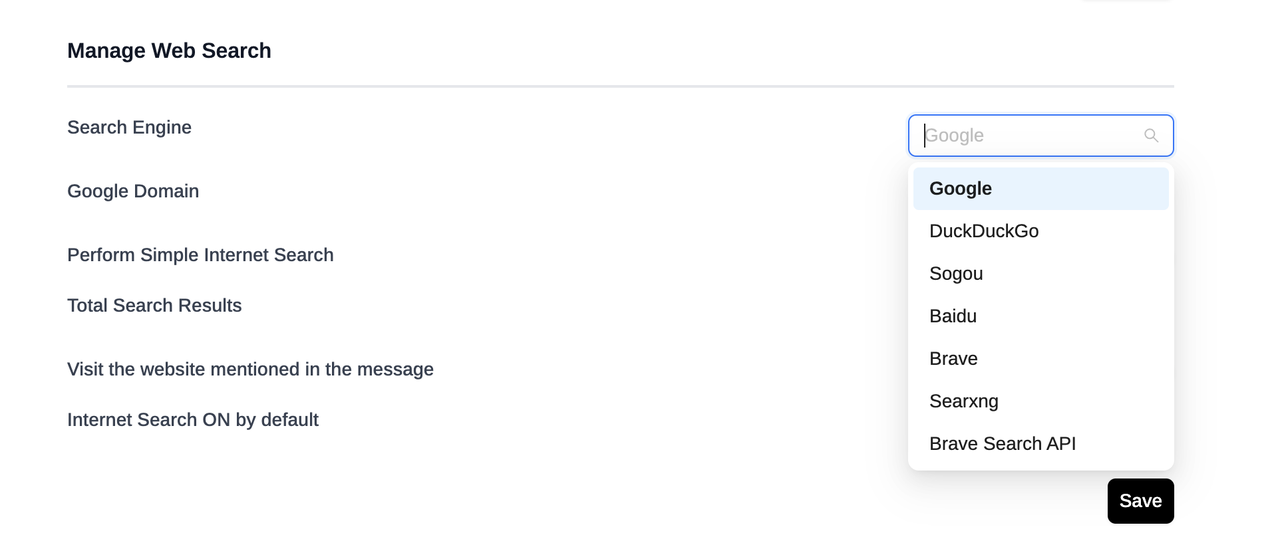

在“Manage Web Search”下选择使用的搜索引擎,选择完成后点击“Save”按钮保存设置。

常用prompt设置(可选)

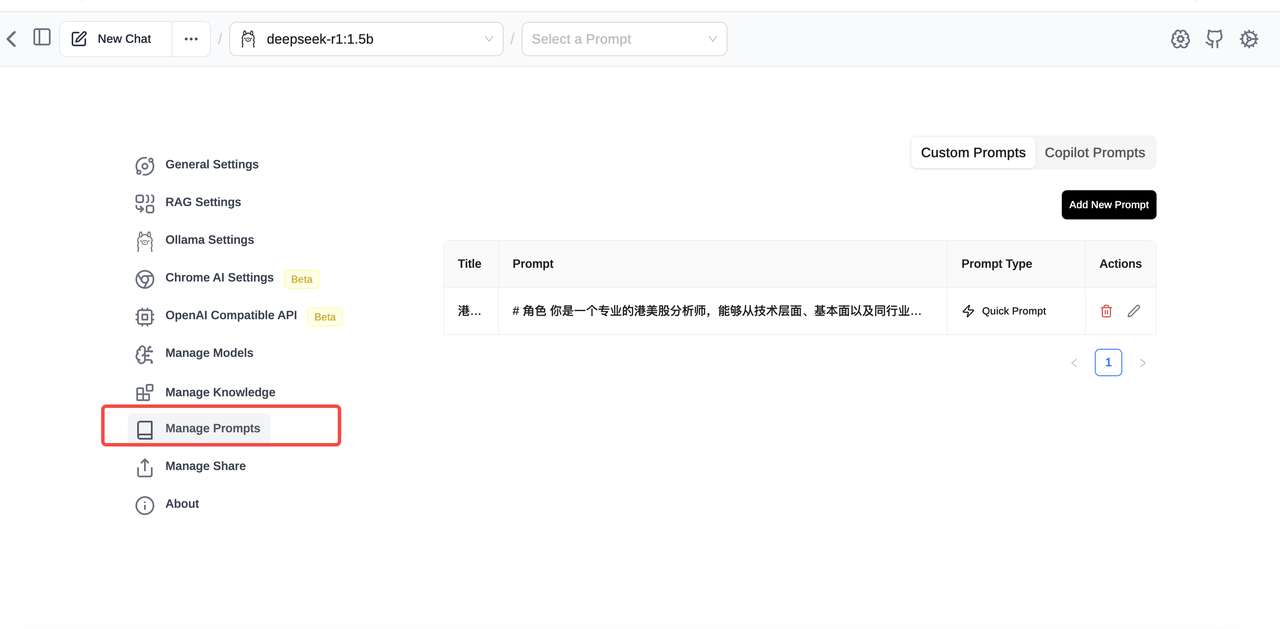

可以在设置页面,选择”Manage Prompt”选项卡,设置常用提示词。

开启对话

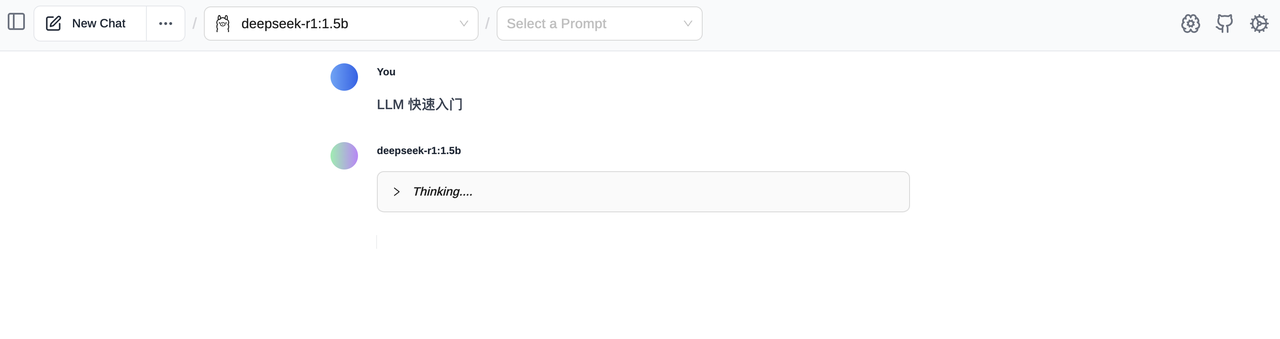

返回首页,页面中选择要使用的本地模型,同时可以选择刚设置的常用prompt,在点击对话框中的联网按钮为“On”,就可以开始本地模型联网对话了

Knowledge设置

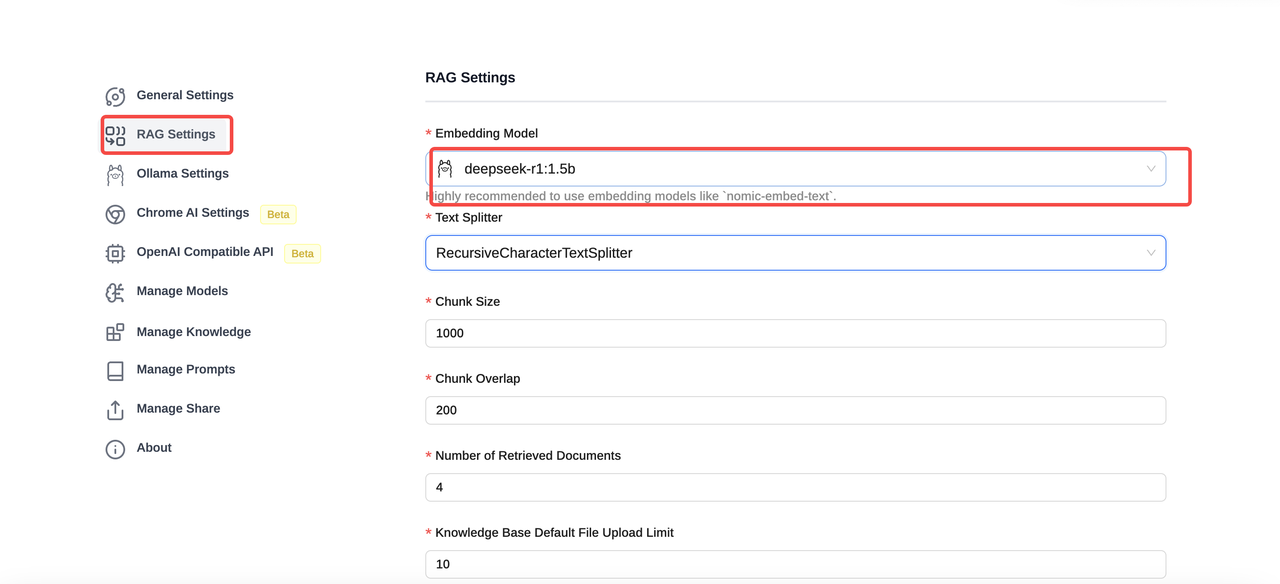

依然通过右上角设置界面进入设置页,在上传knowledge前,先在”RAG Settings”对embading model进行配置

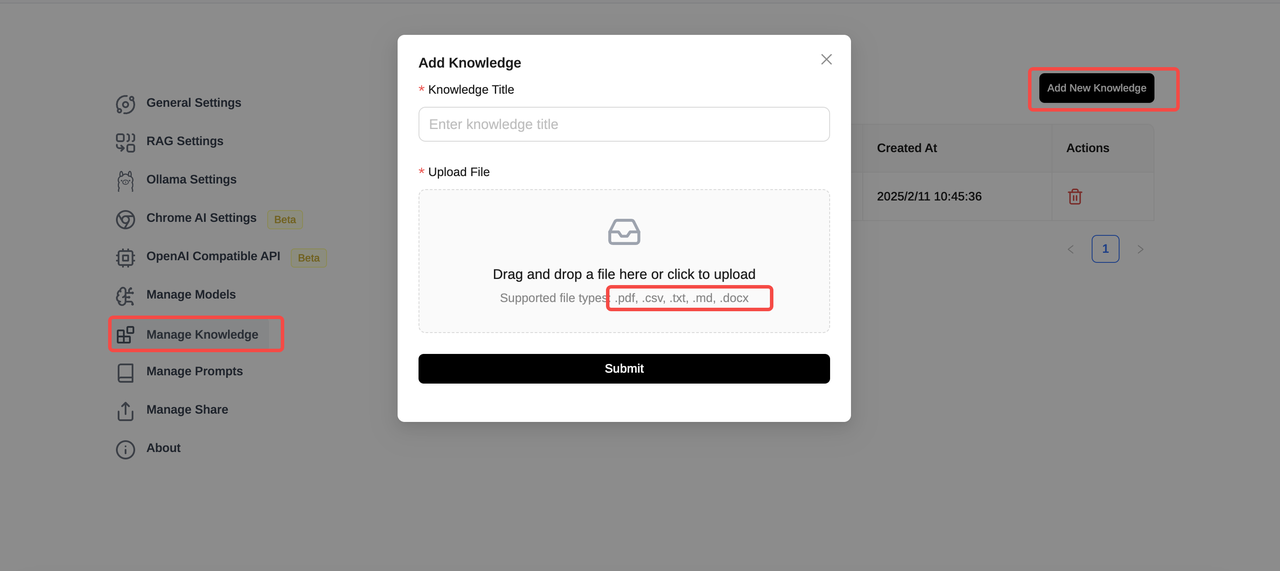

配置完成后,通过左侧栏选择”Manage Knowledge”选项卡,进入知识库配置页面,点击“Add New Knowledge” 来创建知识库内容,目前page assist支持pdf,csv,txt,md,docx五种类型知识上传

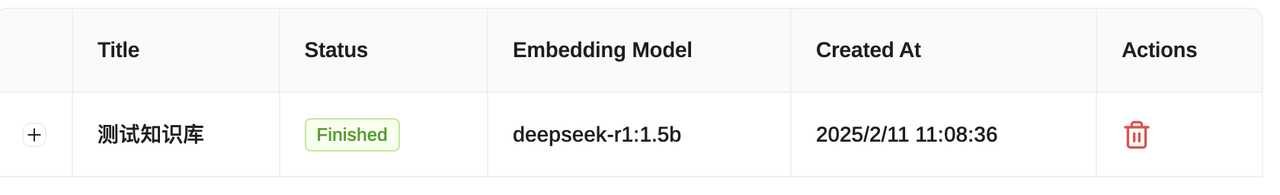

上传后,等待embading模型处理完成,即可在对话中引入知识库

优劣

Page assist 插件通过浏览器插件轻量级的支持ollama本地模型接入,能够快速体验本地模型对话能力,能够快捷接入网络搜索和知识库能力,但是网络搜索和知识库不能并行使用,同时网络搜索只能使用单一搜索引擎,知识库支持常用文本类型,但不支持网络信息导入或者代码库接入。

总结

Ollama作为本地化部署模型的基底,同时提供简单便捷的模型拉取命令,是本地化部署模型的有力提效工具。市面上各种可视化对话工具层出不穷,可以根据个人喜好进行选择。对于本地化部署deepseek模型

优点:可以避免deepseek的算力不足出现的超时问题;由于是本地部署,涉密高敏问题不会出现泄露问题

缺点:依赖硬件性能,一般机器无法使用满血671B模型,效果会差强人意。

大家可以根据个人诉求酌情选择使用deepseek官方或各大云商提供的满血deepseek模型,在工作中达到提效的目的,当然想尝试本地化部署体验从0到1搭建本地化个人助手也是一个不错的体验